C’est quoi la normalisation ? Est-elle toujours nécessaire, ou seulement applicable dans certains cas ? 🤔

👉 La normalisation de l’audio c’est grosso modo l’application d’une quantité constante de gain à l’audio, dans le but d’augmenter l’amplitude jusqu’à un niveau cible.

Lorsque vous normalisez une piste audio, les échantillons du fichier augmentent de la même quantité, de sorte que la valeur d’échantillon la plus élevée devient 0 db, ou proche de 0 db. Si votre échantillon est déjà proche de ça, vous ne remarquerez aucune augmentation de volume.

La normalisation de l’audio est une stratégie pour amener une production à un niveau cohérent.

La normalisation de l’audio ne doit pas être fait sur la piste master, ou pendant le rebond pré-master ou master afin d’éviter les pics inter-échantillons.

➡️ La normalisation ne doit pas être effectuée avant le mixage, car elle peut être destructrice pour votre mix. Et le but du mixage n’est pas d’augmenter le volume des pics de vos pistes, mais de les mélanger avec d’autres pistes du projet.

Dans le cadre du mastering, la normalisation peut vous aider à faire monter votre audio jusqu’à votre plafond numérique, sans devoir utiliser de compression ou de limitation.

Qu’est-ce que la normalisation ?

👉 La normalisation est le fait d’ajouter ou de soustraire une certaine quantité de gain, ou d’amplifier pour rendre un enregistrement audio à un niveau cible et cohérent, avec le reste.

Une bonne normalisation n’affecte pas la plage dynamique de l’audio.

Lorsqu’elle est utilisée à bon escient, elle peut être une excellente alliée pour l’édition audio et le mixage.

✅ Elle est faite dans la musique, la TV, la radio, le podcasting et le streaming. La normalisation de l’intensité sonore des dialogues et des podcasts, peut considérablement améliorer leur qualité.

Il y a 2 types de normalisation :

- La normalisation des crêtes,

- Et la normalisation du volume.

Normalisation des crêtes

👉 Cette normalisation est obtenue en prenant le pic le plus élevé de la forme d’onde, et en l’amenant à la norme avec le reste.

En appliquant la même quantité de gain à tous les niveaux, la dynamique sera respectée, et vous aurez une forme d’onde proche de l’originale (mais plus forte ou plus silencieuse).

Le processus de normalisation des pics est capable de trouver la valeur d’échantillon PCM (Pulse Code Modulation) la plus élevée, et d’appliquer un gain pour amener le pic à 0 dBFS (décibels pleine échelle), qui est la limite supérieure d’un système audio numérique.

Cette normalisation peut également être utilisée pour réduire l’audio, et n’ajuste pas nécessairement le niveau de pic à 0 dBFS (bien que ce soit le plus courant).

La normalisation de crête ne concerne que la détection de la crête du signal audio, et ne tient pas compte de l’intensité sonore perçue de l’audio.

Normalisation du volume

La normalisation de l’intensité sonore est un traitement beaucoup plus complexe.

À des valeurs dBFS égales (et des niveaux de pression acoustique), les sons soutenus sont perçus comme étant plus forts que les sons transitoires.

👉 La normalisation du volume ajuste les niveaux de l’enregistrement à la sortie perçue.

Pour cela, une autre mesure appelée LUFS (Loudness Unit Full Scale) ou LKFS (Loudness, K-Weighted, Relative To Full Scale) est utilisée.

LKFS et LUFS ont des noms différents, mais en réalité c’est la même chose.

LUFS est une unité de mesure de l’intensité sonore standard, utilisée pour la normalisation audio dans les enregistrements.

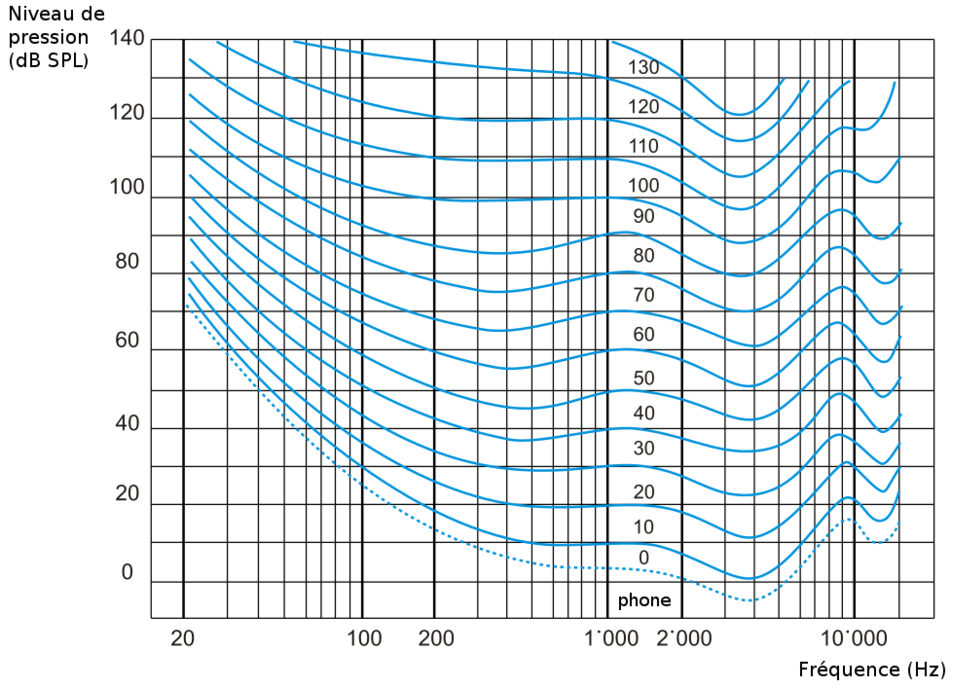

👂 La gamme audible pour l’audition humaine est de 20 Hz à 20 000 Hz. LUFS/LKFS en tient compte pour le volume perçu, contrairement aux valeurs RMS.

LUFS fonctionne avec la détection de volume EBU R-128, pour trouver le volume moyen perçu d’un fichier audio, et pour ajuster le volume perçu global en conséquence.

Ce processus de normalisation peut être utilisé pour augmenter, ou diminuer le niveau global.

Changement LUFS avec normalisation

➡️ Le plus grand effet de la normalisation, est la façon dont elle amène le LUFS à modifier une piste.

La normalisation fait la différence entre un volume élevé et faible.

Une piste qui va être soumise à l’exportation aura donc une ligne plate, dans sa forme audio.

Lorsque la limitation est effectuée pour qu’une musique atteigne un certain palier, elle subit une perte de détails, car il n’y a pratiquement aucune plage dynamique dans la piste.

👉 Si vous n’avez que la version mixée de la musique pour le mastering, vous ne pourrez pas faire grand-chose. Vous devrez simplement vous assurer que la piste sonne aussi bien que possible, avec le volume maximum qu’elle peut atteindre, en utilisant une faible limitation.

Les détails perdus dans une étape limite ne peuvent pas être récupérés.

C’est pourquoi la normalisation n’est pas essentielle pour ajouter du volume à la piste. C’est aussi l’une des raisons pour lesquelles, la normalisation a été laissée de côté dans la production de logiciels.

Normalisation VS Compression dynamique

👉 La compression de plage dynamique est le processus de réduction de la plage dynamique d’un signal audio. La compression le fait en atténuant l’amplitude du signal au-dessus d’un seuil défini, et en fournissant un gain de compensation pour compenser les niveaux perdus.

👉 Avec la normalisation, la quantité de gain appliquée à l’ensemble de l’enregistrement est cohérente. La plage dynamique sera préservée. L’audio résultant sera donc le même que l’original.

Les avantages & les inconvénients de la normalisation audio

Avantages

Cohérence du volume

Le premier avantage est la cohérence du volume. Il faut que rien ne sonne bizarrement, même si le niveau sonore est enregistré dans différentes conditions, et différents endroits.

Évitez les crêtes supérieures à 0 dBFS

À des taux d’échantillonnage élevés, la normalisation d’une piste pour atteindre le volume maximal maintiendra l’audio au niveau, ou en dessous du maximum numérique, évitant ainsi la distorsion.

Les limiteurs offrent le même résultat, même si, comme la compression, ils le font en affectant la plage dynamique de l’audio.

Inconvénients

La normalisation peut tout ruiner

Même si les DAW peuvent offrir énormément de niveaux d’annulation, tout ce qui a été fait ne peut pas être annulé.

La plupart des programmes vous demanderont de créer une nouvelle version du fichier pour le normaliser.

⚠️ Si vous avez perdu le fichier original non traité, vous ne pourrez pas annuler le processus de normalisation.

Pics inter-échantillons

Si la fréquence d’échantillonnage est trop faible, le 0 dBFS peut être dépassé lors de la normalisation pendant le rebond.

Cet écrêtage se produit quand l’audio numérique est reconstruit comme audio analogique, et que la forme d’onde continue coupe entre 2 ou plusieurs échantillons numériques, qui étaient trop proches de 0 dB.

Normaliser l’audio

Échantillons

La normalisation des échantillons audio permet d’avoir la garantie, que vous n’aurez pas à modifier les niveaux pour équilibrer les pistes pendant le mixage.

Normaliser chaque échantillon avant qu’il n’entre dans le mixage, est donc une très bonne idée.

Normalisation de l’assemblage

Lors de la constitution d’une collection d’enregistrements, la normalisation du volume peut être utilisée, pour s’assurer qu’il n’y a pas de sauts de volume d’une piste à l’autre.

Pour égaliser les différences dans une prise vocale

Vous pouvez normaliser une prise vocale, en la réduisant en morceaux et en utilisant vos oreilles comme repère.

Effectuer une normalisation uniquement sur les sections à faible volume, n’augmentera le volume que là où il en manque, et créera un son plus cohérent.

N’abusez pas de cette méthode, car vous risqueriez de tuer la dynamique vocale.

Quand éviter de normaliser l’audio

Lors du bounce d’une piste

Une erreur courante consiste à ajouter un plug-in de normalisation au bus maître, pendant le bounce.

Un pic inter-échantillons peut se produire, ce qui créera une distorsion et des artefacts dans la piste finale, qui n’étaient pas là dans la session.

Une piste de pré-mastering

Si vous êtes sur le point d’envoyer une piste au mastering, et que vous pensez qu’il est nécessaire d’augmenter le volume des sections à faible volume, la normalisation peut être bénéfique.

Quelle est la meilleure méthode pour normaliser l’audio ?

Détection du volume maximal

Cela ne prend en compte que le niveau sonore des crêtes de la forme d’onde, pour décider du volume global du fichier. C’est la meilleure méthode si vous voulez rendre le son aussi fort que possible.

En audio numérique, vous ne pouvez pas obtenir plus fort que le pic le plus élevé à 0 dBFS.

La normalisation à cette valeur créera donc le fichier le plus fort possible.

Détection du volume RMS

Cela prend en compte le volume global d’un projet.

👂 Cette méthode est plus proche du fonctionnement de l’oreille humaine, et créera un environnement sonore plus naturel sur différents fichiers audio.

Les humains perçoivent différentes fréquences à différents volumes. Cette perception est illustré sur la courbe de Fletcher-Munson.

Si un fichier a de nombreuses fréquences entre 1000 et 6000 Hz, il sonnera plus fort.

👉 RMS (Root Mean Square) n’en tient pas compte.

La norme en matière de diffusion audio EBU R 128 est une solution pour ça.

Détection de volume EBU R 128

C’est une manière similaire de mesurer le volume en tant que RMS, mais qui s’approche beaucoup plus de l’audition humaine.

EBU R 128 prend en compte le fait que les humains entendent des fréquences, comprises entre 1000 et 6000 Hz, comme plus fortes.

Il y a toujours le même problème de 0 dBFS mentionné pour RMS. Mais les différents fichiers audio normalisés devraient sembler beaucoup plus cohérents, en termes de volume.

Autres questions

Quelle est la différence entre la compression audio et la limitation ?

La compression et la limitation de la plage dynamique fonctionnent, sur le principe de réduction de la plage dynamique d’un signal audio.

La limitation est la compression avec un rapport très élevé (souvent infini). Les limiteurs sont conçus pour définir un niveau de sortie maximal.

Les compresseurs réduisent, quant à eux, les niveaux de signal au-dessus d’un seuil défini par un rapport.

Qu’est-ce que la compression ascendante ?

La compression ascendante est un type de compression de plage dynamique, qui augmente l’amplitude d’un signal audio en dessous d’un certain seuil, tout en maintenant l’amplitude au-dessus du seuil.

Elle est disponible dans les plugins numériques, et via la compression parallèle avec du matériel ou des logiciels.

Dois-je normaliser mes échantillons ?

Oui, la normalisation des échantillons vous donnera plus de contrôle pendant le mixage, avec les sons les plus forts.

Si votre projet a de nombreux échantillons à faible volume, il est préférable de les normaliser, pour qu’ils soient au même niveau que les échantillons forts du mixage.

Faut-il normaliser le rebond ?

Normaliser une piste rebondie fera plus de mal que de bien.

➡️ Cela réduira la qualité de la piste, et gâchera les niveaux de volume définis pour les plateformes de streaming.

Si la sortie est perturbée, il risque d’y avoir des artefacts étranges, une fois que la piste sera à nouveau normalisée par le système de diffusion en continu.

Quand faut-il normaliser ?

👉 Le seul moment où il faut normaliser, c’est lorsque vous n’avez pas la possibilité de limiter la piste, mais que vous devez augmenter le volume global de la piste, sans créer de clip de piste.

La normalisation d’une piste n’est pas nécessaire, car il existe plus d’effets disponibles pour obtenir le même résultat.

YouTube normalise-t-il l’audio ?

Oui, YouTube normalise l’audio quand le volume de la piste est inférieur à -48 dB.

Cela permet de garantir que la piste est toujours audible dans tous les systèmes, quel que soit le volume appliqué.

Dois-je normaliser avant de masteriser ?

Cela dépend de la façon dont la musique est mixée.

Si le morceau n’est pas encore bouclé, et qu’il comporte de nombreuses régions à faible volume, il est préférable que le morceau soit normalisé.

S’il a déjà été poussé à ses limites lors du mixage, il est préférable de sauter la normalisation, et de passer directement au mastering.